AMD CDNA 4 架构与 MI350技术解析|Hot Chips 2025

在2025年HotChips大会上,AMD对外详细阐述了其最新的CDNA4架构以及基于该架构的MI350系列加速器。

与前代MI300相比,MI350在工艺、封装、内存层次结构和互连带宽上进行了全面升级,目标直指快速膨胀的大模型训练与推理市场。

其核心亮点包括1850亿晶体管的堆叠式设计、3nmN3P工艺计算芯片、双NUMA域灵活分区、FP4/FP6等新型低精度数据格式支持,以及ROCm软件生态的进一步优化。

AMD试图借助MI350系列在超大规模AI计算中的部署优势,缩小与竞争对手在算力市场的差距,功耗、系统集成难度和生态成熟度等问题仍然是其未来能否大规模渗透的关键挑战。

AMD架构演进:

从芯粒堆叠到数据类型

CDNA4架构的设计延续了AMD在MI300上的3D堆叠思路,但在关键细节上进行了大幅度优化。

通过技术的演进,MI350既在性能指标上提升了一个量级,也在功耗控制与灵活性方面引入了更多机制,从而更好地适应AI模型参数规模持续增长的趋势。

●工艺与封装升级

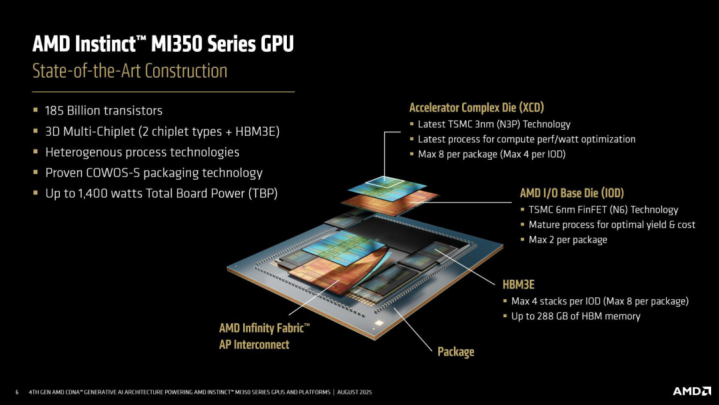

MI350采用台积电3nmN3P工艺制造计算芯片,带来更优的能效比。

AMD沿用了“基座芯片+计算芯片”的分层堆叠设计,每个基座上集成4个计算芯片,最终在一对I/O芯片上实现多达8个XCD的封装,总晶体管数达到1850亿个,远超上一代MI300的规模。

这种高度集成不仅带来性能提升,也反映出AMD在先进封装上的成熟度。

I/O芯片依旧使用6nm工艺,AMD在会上直言,尝试缩小工艺节点对基础芯片几乎没有收益。

原因在于I/O芯片的关键任务是承担互连与数据传输,过高的制程并不能显著提升带宽,却会推高成本。

AMD的取舍体现出一种工程上的务实,即在计算密集部分推进制程,而在互连与控制部分追求稳定与成本平衡。

●内存层次与带宽扩展

相较于MI300,MI350的InfinityFabric互连由IF3升级至IF4,每插座带宽提升了2TB/s。这种带宽提升对AI模型尤为重要,因为训练与推理过程对内存访问的需求呈指数级增长。

与此同时,MI350将本地数据存储(LDS)容量翻倍,使得核心在访问临时数据时延更低,进一步提升了吞吐效率。

更大容量的HBM内存为模型训练提供了支撑,也让用户在相同算力需求下需要更少的GPU数量,从而降低同步开销与能耗。这一点对于超大规模模型训练尤其重要,因为跨GPU同步往往是训练效率的瓶颈。

●数据类型与算力优化

在数据类型支持方面,CDNA4引入了对FP6和FP4精度格式的硬件支持,并将传统AI数据类型的吞吐率几乎翻倍。

低精度算术对于生成式AI模型训练与推理尤为关键,因为它们允许在牺牲有限精度的前提下,大幅提升算力利用率与能效。

AMD在演示中强调,在FP4/FP6支持下,MI350在部分推理任务中的速度有望超过竞争对手两倍以上。

MI350的峰值时钟频率可达2.4GHz,结合8个XCD及每个XCD4MB的L2缓存,整体计算密度进一步提升。这种数据类型与时钟频率的结合,使MI350成为面向大语言模型与生成式AI的高适配产品。

●灵活的GPU分区机制

CDNA4的另一个重要特征是灵活的GPU分区。MI350可以作为单一NUMA域运行,也可以划分为两个域,从而减少跨芯片访问延迟。

此外,单个XCD还能够被划分为独立的计算分区,类似于在一颗GPU中提供多实例化的能力。

这种灵活性意味着用户可以根据任务规模与延迟需求,将MI350作为单一大芯片或多个中型芯片使用,适配从超大模型训练到中型推理的不同场景。

总体而言,MI350的架构演进体现出三个方向:

◎一是工艺制程与堆叠规模的持续推进,

◎二是内存带宽与缓存层次的全面扩展,

◎三是数据类型支持的多样化与灵活性。

这些进展共同指向一个核心目标,即在AI模型规模迅速膨胀的背景下,为训练与推理提供更高效、更灵活的硬件支撑。

Part2

市场应用与战略影响:

从机架部署到软件生态

MI350系列如何在现实市场落地,将决定AMD能否在与竞争对手的算力大战中获得更大份额。

MI350系列分为MI350X(风冷)与MI355X(液冷)。

◎前者作为MI300的直接升级,能够兼容现有的数据中心基础设施;

◎后者则面向超大规模计算场景,单GPU功耗可达1.4kW,但通过液冷实现高效散热,AMD并不单纯追求顶级性能,而是希望兼顾传统数据中心与新一代高性能集群的不同需求。

在机架级部署方面,液冷方案最多支持单机架96至128个GPU,而风冷方案上限为64个GPU。AMD甚至提供了参考机架方案,将GPU、CPU与横向网络接口均纳入AMD自研体系。

这种“整机架解决方案”不仅展示了AMD在硬件层面的系统能力,也体现了其向整体平台供应商转型的战略企图。

硬件性能的释放离不开软件支持。

AMD在HotChips上特别强调ROCm7的逐步完善,尤其是在兼容主流AI框架、提升编译优化与运行时效率方面取得进展。过去AMD在AI生态上落后于竞争对手,但ROCm的迭代显示其正在缩小差距。

AMD在灵活分区与NUMA优化上的软件支持,将成为MI350吸引超大规模用户的重要条件。

对于需要部署数百甚至上千GPU的云计算厂商而言,软件层面的灵活性与稳定性比单个芯片的性能提升更具价值。

AMD在MI350上的进展正值AI硬件需求爆发的关键时期。

◎大语言模型的上下文窗口不断拉长,对显存和带宽的需求持续攀升;

◎生成式AI应用的普及也推动了推理端的算力消费。

在这一趋势下,AMD试图通过MI350系列满足高端市场的性能要求,并借助与OEM、云服务商的合作,扩大部署规模。

挑战仍然存在。

◎单GPU功耗高达1.4kW对数据中心电力与散热提出了严苛要求,意味着潜在用户必须投入额外成本改造基础设施。

◎ROCm正在追赶,但生态成熟度仍然逊色于CUDA,这将影响开发者的迁移意愿。

◎最后,竞争对手在市场占有率与客户绑定方面依旧具有优势,AMD能否真正突围,还需在产品之外展现出供应链稳定性与长期路线图执行力。

MI350在市场应用上的价值体现在三方面:通过双平台设计满足不同用户需求,通过ROCm优化增强生态适配性,以及通过整机架方案展示系统级能力。但要实现规模化突破,AMD仍需应对功耗、生态和市场惯性的挑战。

HotChips2025上的MI350/CDNA4发布,是AMD在AI硬件赛道上的一次重要节点。通过在工艺、封装、内存和数据类型上的全方位升级,MI350系列不是AMD试图以整个平台能力切入超大规模AI市场的战略体现。

特别声明:以上内容仅代表作者本人的观点或立场,不代表新浪财经头条的观点或立场。如因作品内容、版权或其他问题需要与新浪财经头条联系的,请于上述内容发布后的30天内进行。